Pronto:ARエクスペリエンスのラピッドビデオプロトタイピングツール

デザイナーは、ARエクスペリエンスのプロトタイプを迅速に作成するためのツールが限られています。3人のARデザイナーに現状の課題をヒアリングし、AR設計で繰り返し発生するいくつかの問題を特定しています。3Dアセットの作成と配置、変化するユーザーの位置の処理、複数のアニメーションの調整が挙げられています。

そこで、デンマークのオーフス大学の研究チームは、2Dビデオと3D操作を組み合わせたタブレットベースのビデオプロトタイピングシステム、PROJECT PRONTOを開発し、その研究成果を2020年度のCHI会議にて報告しています。

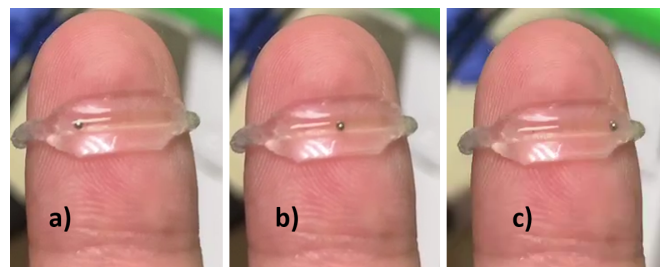

PRONTOは4つの絡み合ったアクティビティ、ビデオシナリオに沿った3D空間情報のキャプチャ、3Dワールドでの2D図面の配置とスケッチ、物理的な相互作用によるアニメーションの実行をサポートするそうです。PRONTOを使用して多様なAR体験のプロトタイプを作成できることを実証したと報告しています。

同時に、このシステムが使いやすいと答えたデザイナーが多く、現在の慣行よりもデザインの探索を奨励していると答えたそうです。ラピッドプロトタイピングのワークフローの幅が広がる可能性を感じます。

Follow @aurordesign [1] : Leiva, G., Nguyen, C., Kazi, R. H., & Asente, P. (2020, April). Pronto: Rapid Augmented Reality Video Prototyping Using Sketches and Enaction. In Proceedings of the 2020 CHI Conference on Human Factors in Computing Systems (pp. 1-13).